Mirantis ist als neuer Technology Partner der VAST Cosmos Community beigetreten und erweitert gemeinsam mit VAST Data das k0rdent AI Ökosystem um einen standardisierten Integrationspfad. Dieser verringert den individuellen Abstimmungsaufwand für Neocloud-Betreiber, indem er wiederholbare Prozesse ermöglicht. Die partnerschaftlich entwickelte Lösung sorgt für eine hohe GPU-Auslastung, optimiert den Datendurchsatz und vereinfacht die Orchestrierung komplexer Multi-Vendor-Umgebungen. Betreiber profitieren so von schneller bereitgestellten, leistungsstarken KI-Services und verbesserter Infrastrukturökonomie. Dabei bleibt es flexibel.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

Mirantis integriert VAST Cosmos Technologien in k0rdent AI Ökosystem

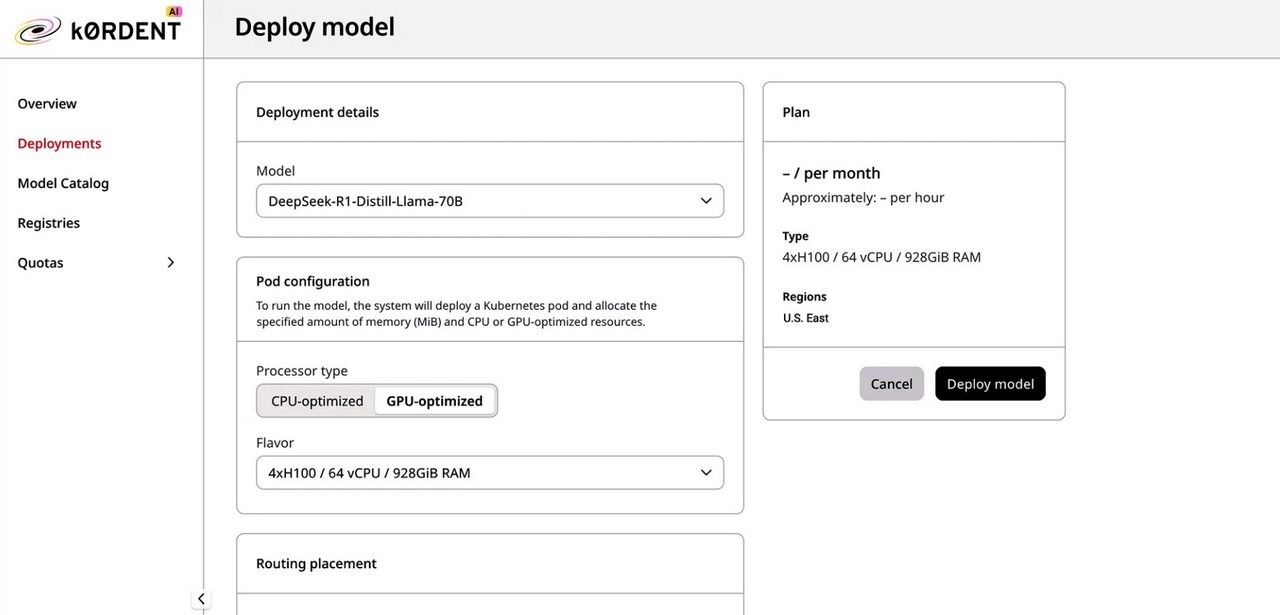

Mirantis hat seine Kubernetes-native Plattform k0rdent AI als Technology Partner der VAST Cosmos Community von VAST Data etabliert. Gemeinsam bieten die Unternehmen Betreibern von Neoclouds einen standardisierten Integrationspfad, der VAST-Technologien nahtlos in k0rdent AI einbettet. Der Ansatz reduziert individuelle Anpassungen und vereinfacht die Orchestrierung heterogener KI-Infrastruktur-Stacks. Dadurch verkürzen sich Einführungszeiten für Hochleistungs-Inferenzdienste, während GPU-Auslastung und Datendurchsatz auf optimierten Speicher- und Netzwerkarchitekturen maximiert werden. Kooperation richtet sich an Betreiber flexibler Multi-Vendor-Umgebungen.

Standardisierter Integrationweg für VAST OS in k0rdent AI Plattform

Mirantis und VAST Data entwickeln gemeinsam einen standardisierten Integrationspfad, um das VAST KI-Betriebssystem nahtlos in die k0rdent AI Plattform einzubinden. Dieser einheitliche Ansatz ersetzt individualisierte Lösungen durch reproduzierbare Abläufe und reduziert den Integrationsaufwand. Die modulare, offene Architektur von k0rdent AI ermöglicht flexible Kombinationen aus Rechenleistung, Netzwerk und Speicherkomponenten. VAST Data liefert dynamische Datendienste, die Performance, Datendurchsatz und Skalierbarkeit der KI-Infrastruktur optimieren. Damit lässt sich der Betrieb schneller und zuverlässiger gestalten.

Kooperation von Mirantis und VAST beschleunigt Neocloud GPU-Skalierung deutlich

Kevin Kamel, Vice President of Product Management bei Mirantis, hebt hervor, dass Betreiber von Neoclouds zunehmend gefordert sind, GPU-Ressourcen effizient zu nutzen und Engpässe zu vermeiden. Durch die Partnerschaft entfallen aufwendige Integrationsaufgaben, was den Betrieb deutlich vereinfacht und die Skalierung beschleunigt. Dadurch können sich Teams auf die Performanceoptimierung konzentrieren und Hochleistungs-KI-Dienste schneller bereitstellen, ohne sich durch manuelle Konfigurationen und langwierige Abstimmungsprozesse ausbremsen zu lassen und gleichzeitig die Wirtschaftlichkeit nachhaltig steigern.

Integriertes VAST Data Framework optimiert nahtlos KI-Durchsatz und GPU-Auslastung

Moderne KI-Plattformen stoßen häufig auf Leistungslimits durch Engpässe im Speicher und in den Datenpipelines, wodurch wertvolle GPU-Reserven ungenutzt bleiben. VAST Data setzt dem integrierte Datendienst-Framework entgegen, das sämtliche Prozessphasen von Modelltraining über Low-Latency-Inferenz bis hin zu komplexen, agentischen AI-Workloads abdeckt. Durch die Verschmelzung mit k0rdent AI entsteht ein hochskalierbarer Technologie-Stack, der Datenzugriffe beschleunigt, Durchsatz optimiert und die Auslastung von Rechenressourcen effizient maximiert. Zur Minimierung von Latenzzeiten und Infrastrukturkosten dynamisch.

Mirantis und VAST Data fördern NVIDIA-geführte Referenzarchitektur für KI-Infrastruktur

Mirantis und VAST Data engagieren sich aktiv in umfangreichen Ökosystem-Initiativen, insbesondere an NVIDIA-geführten Referenzarchitekturen für großskalige GPU-Umgebungen. Diese Architektur-Leitfäden spezifizieren präzise, wie Rechenleistung, Netzwerkkomponenten und Speichersysteme ideal integriert werden. Betreiber profitieren von geprüften Modulkomponenten anstatt maßgeschneiderter Einzellösungen, was zu höherer Sicherheit, vorhersehbaren Leistungsmerkmalen und vereinfachtem Betrieb führt. So lassen sich KI-Infrastrukturen skalierbar, effizient und robust betreiben, und wirtschaftlich skalieren können, besonders für Multi-Milliarden-Projekte.

Neoclouds beschleunigen KI-Bereitstellung mit k0rdent Kubernetes Automation und Skalierung

Neocloud-Anbieter, die GPU-Cloud- und KI-Dienste auf Kubernetes-Plattformen errichten, profitieren von k0rdent. Standardisierte Deployments reduzieren manuelle Eingriffe durch vordefinierte Infrastruktur-Muster und native Automatisierung. Betreiber automatisieren Konfigurations- und Skalierungsprozesse, wodurch Entwicklungs- und Bereitstellungszeiten signifikant verkürzt werden. Gleichzeitig optimiert k0rdent die Auslastung der GPU-Ressourcen, indem es dynamische Workload-Verteilung und automatische Skalierung unterstützt. Dieser Ansatz ermöglicht eine effiziente Verwaltung komplexer KI-Architekturen und beschleunigt die Markteinführung neuer KI-Services. Die wiederholbare Vorgehensweise sorgt für Konsistenz. dauerhaft.

Mirantis und VAST Data optimieren GPU-Auslastung für Kubernetes-native KI-Clouds

Die Kooperation zwischen Mirantis und VAST Data liefert einen einheitlichen Integrationsansatz, der individuelle Anpassungen minimiert und den Aufwand für komplexe KI-Infrastrukturen deutlich verringert. Durch standardisierte Schnittstellen und validierte Bausteine beschleunigen Neocloud-Betreiber die Implementierung von KI-Workflows, während Kubernetes-native Automatisierung sicherstellt, dass GPU-Ressourcen optimal genutzt werden. Validierte Referenzarchitekturen gewährleisten vorhersehbare Leistung und stabile Abläufe. Gleichzeitig erleichtert der integrierte Datendienstdurchsatz Engpassbeseitigung und erhöht die Wirtschaftlichkeit von Hochleistungs-KI-Diensten erheblich und unterstützt dynamische Skalierungsanforderungen effizient.